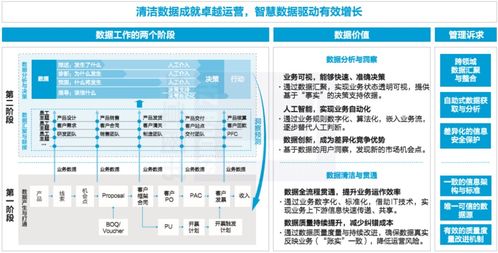

在当今以视觉为主导的互联网时代,图片搜索已成为连接用户与海量信息的关键桥梁。支撑一个拥有7亿用户的图片搜索服务,其背后必然需要一个强大、稳定且高效的中台系统,尤其是在数据处理与存储支持方面。这个中台不仅是技术能力的体现,更是支撑庞大规模、复杂业务与极致用户体验的工程基石。本文将深入解析这一中台的核心——数据处理与存储支持服务,揭示其如何承载巨量并发,并确保搜索的实时、准确与可靠。

一、 核心挑战与设计原则

面对7亿用户的搜索请求,系统面临的挑战是立体且严峻的:

- 数据规模巨大:每天需处理、存储和索引数十亿甚至数百亿张图片及其衍生数据(如特征向量、缩略图、元信息等)。

- 处理实时性要求高:图片被上传或更新后,需在极短时间内完成处理并可供搜索,以保障内容的新鲜度。

- 查询并发极高:峰值时刻需同时响应全球数百万用户的搜索请求,要求毫秒级延迟。

- 数据可靠性至关重要:任何数据丢失或损坏都会直接影响搜索质量和用户体验。

- 成本与效率的平衡:在满足性能与可靠性的前提下,必须优化存储与计算成本。

为此,数据处理与存储中台的设计遵循以下核心原则:弹性可扩展、高可用与容灾、最终一致性保障、成本优化。

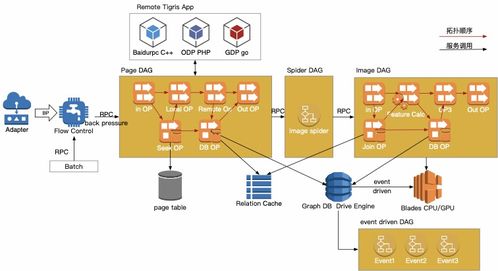

二、 数据处理流水线:从原始图片到可搜索索引

图片的处理是一个复杂且分阶段的流水线作业,中台需要将其标准化、服务化。

- 摄入与标准化:系统通过多种渠道(如用户上传、网络爬虫、合作伙伴接入)接收海量异构的原始图片。首要任务是通过统一的接入网关进行格式验证、去重(如计算感知哈希)、基础信息提取(如EXIF)和标准化转换(统一为WebP/AVIF等高效格式),形成规范的“原始数据包”。

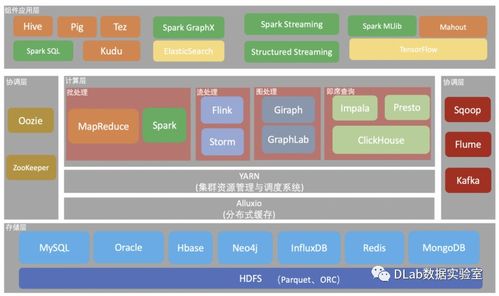

- 计算密集型处理:这是核心环节,通常采用异步、分布式任务调度框架(如Apache Flink、Kafka Streams结合自研调度器)。关键步骤包括:

- 特征提取:利用深度卷积神经网络(CNN)模型,将图片转换为高维特征向量。这是实现“以图搜图”和语义搜索的基石。模型服务化部署在GPU集群上,通过批量处理优化吞吐。

- 标签与分类:同时运行多个视觉识别模型,为图片打上丰富的结构化标签(对象、场景、属性等)并进行分类,构建文本可搜索的索引。

- 质量评估与过滤:自动评估图片的视觉质量、审美得分,并过滤掉低质、敏感或违规内容,确保索引库的健康度。

- 元数据与索引构建:处理完成后,系统将特征向量(用于相似性搜索)、结构化标签、文本描述、缩略图存储地址、原始图存储地址等关键信息关联整合,形成一条完整的图片“档案”。这些数据被分别送入不同的索引系统:

- 向量索引引擎:针对高维特征向量,使用近似最近邻搜索(ANN)算法库(如Faiss、HNSW)构建索引,以实现毫秒级的相似图片检索。

- 倒排索引引擎:针对标签和文本信息,使用如Elasticsearch等系统构建倒排索引,支持关键词组合搜索。

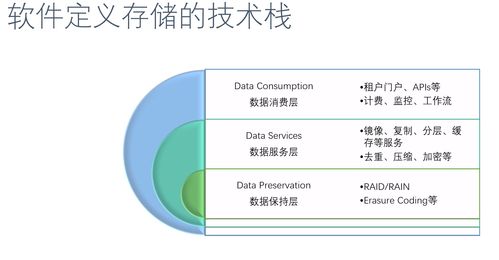

三、 分层存储架构:平衡性能、成本与可靠性

为应对不同数据的访问模式与重要性,中台采用典型的分层存储架构。

- 热存储层(对象存储 + CDN):

- 存储内容:多种分辨率的缩略图,这是访问最频繁的数据。

- 技术选型:使用高可靠、高并发的对象存储服务(如自建存储集群或公有云S3兼容服务)作为持久化源站。所有缩略图通过全球分布的内容分发网络(CDN)进行加速,将图片推至离用户最近的边缘节点,极大降低访问延迟,并减轻源站压力。

- 温存储层(对象存储):

- 存储内容:处理后的原始高清图片。访问频率低于缩略图,但需保证随时可用。

- 技术特点:通常使用成本略低于热存储但依然高可用的对象存储服务,可能配置不同的存储级别(如标准-低频访问)。

- 冷存储层(归档存储):

- 存储内容:原始上传的、未经处理的备份数据,或法律法规要求长期保留的图片。极少访问,但必须长期保存。

- 技术特点:采用成本极低的磁带库或冰川式归档存储服务,检索延迟较高,但长期保存成本优势巨大。

- 元数据与索引存储:

- 存储内容:图片的特征向量、标签、关系图谱等结构化数据。

- 技术选型:根据数据类型和访问模式,组合使用多种数据库:

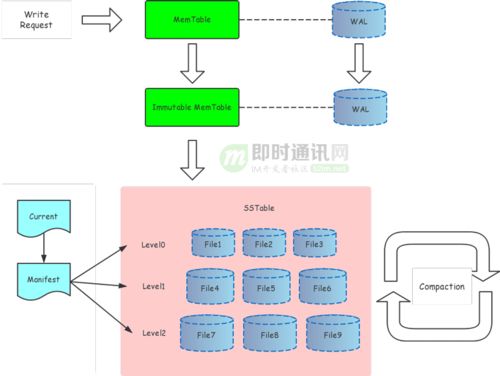

- 关系型数据库(如MySQL/PostgreSQL):存储强一致性的核心元数据(如图片ID、所有者、基础属性)。

- NoSQL数据库(如HBase/Cassandra):存储海量的、稀疏的标签和特征数据,具备良好的水平扩展能力。

- 分布式文件系统/对象存储:存储序列化后的特征向量文件,供向量索引引擎加载。

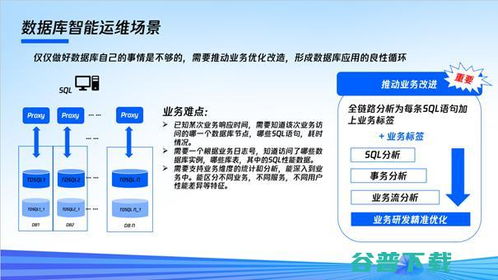

四、 核心支持服务:保障系统平稳运行

- 统一调度与资源管理:基于Kubernetes和YARN等容器化编排平台,实现计算资源(CPU/GPU)的弹性调度,根据数据处理流水线的负载动态扩缩容,提高资源利用率。

- 数据一致性服务:通过发布-订阅消息队列(如Kafka)实现各子系统间的解耦和数据最终一致性。任何图片的状态变更(如更新、删除)都会作为事件发出,驱动索引、缓存等系统异步更新。

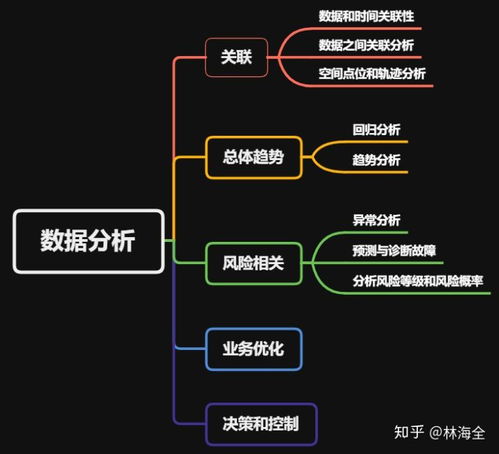

- 监控与治理体系:建立全方位的监控,覆盖从数据摄入延迟、处理成功率、存储可用性到索引新鲜度等所有关键指标。结合智能告警和根因分析,确保问题能被快速发现和定位。通过生命周期管理策略,自动将数据在不同存储层间迁移或清理,优化成本。

- 容灾与多活:在存储层面,数据跨地域多副本存储,确保即使单个数据中心故障,服务也不中断。在索引层面,可能构建跨地域的索引镜像,通过智能流量调度实现异地多活,提升全球用户的访问体验。

五、

支撑7亿用户的图片搜索中台,其数据处理与存储服务是一个将大规模分布式计算、智能视觉算法与分层存储基础设施深度融合的复杂系统工程。它通过标准化的流水线将原始图片转化为可搜索的知识,并利用分层的存储策略在性能、可靠性与成本间取得精妙平衡。这一切,都依赖于背后一套完整的调度、一致性、监控与容灾支持服务的无缝协作。这个中台不仅是当前业务的强大引擎,其弹性、可扩展的设计也为未来用户规模的增长和业务形态的演进预留了广阔空间。它无声地运转,却是用户体验流畅、结果精准的最终保障。